Umělé inteligence (AI) vznikly mnohdy na základě toho, že jejich provozovatelé je trénovali na nelegálně získaných datech. Tato praktika funguje dál a cílí na samotné modely AI. Vývojáři společnosti Anthropic tento týden upozornili, že tři čínské společnosti zabývající se umělou inteligencí „nelegálně získaly“ schopnosti modelu Claude. Ten je považovaný za jednu z nejvyspělejších AI současnosti.

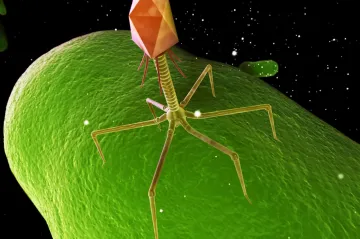

Vývojáři popsali, že čínské AI „destilovaly“ schopnosti modelu společnosti Anthropic. Podněcovaly ho speciálně připravenými příkazy, aby se z jeho odpovědí samy učily a zlepšovaly se. Připomíná to špičkovou soukromou školu, kam se vloudí neplatící student.

Destilace je legitimní metoda, která se často používá například pro trénink modelů tak, aby byly levnější, menší a úspornější. V tomto případě to ale dle Anthropicu byla jiná situace: americká firma označuje aktivitu čínských konkurentů za „destilační útoky“. Podle vyjádření společnosti nejsou sice zřejmě trestné, ale pravděpodobně odporují podmínkám užívání služby Claude.

Anthropic označil obcházení pravidel za problém, zejména proto, že společnosti „podléhající kontrole Komunistické strany Číny“ tak mohou eliminovat domnělou konkurenční výhodu amerických firem.

Řada médií viní Anthropic z pokrytectví. I tato firma, stejně další v oboru, totiž získávala data pro trénink svého AI modelu Claude pomocí takzvaného scrapování – tedy získávání dat z webů, přičemž některé to ve svých podmínkách užití zapovídají.

Anthropic z toho obvinila například diskusní platforma Reddit, která tvrdí, že Claude byl natrénován na datech a konverzacích právě tohoto webu. A to dokonce i z dat, která byla označena jako určená ke smazání, což pravidla explicitně zakazují. Podle Redditu se toho měl Anthropic dopouštět v letech 2021 až 2024.

Z tohoto chování viní Anthropic také generální ředitel společností Tesla a xAI Elon Musk. Ten nedávno prohlásil, že společnost Anthropic ukradla velké množství dat za účelem trénování svých modelů. Musk tvrdí, že k této krádeži dat došlo v obrovském měřítku, což vedlo k tomu, že společnost musela zaplatit miliardy dolarů na vyrovnání. Pro zajímavost: ze stejného chování obviňují experti i Muskovu AI Grok.

AI firmy pro tréninky svých modelů použily obrovské množství licencovaného obsahu, čemuž napovídá například to, že modely jsou schopné věrně přepsat takřka celé konkrétní knihy. Společnost Meta podle spisovatelů, kteří se obrátili na soud, zneužila na osmdesát terabajtů dat z on-line knihoven. V Británii se zase hudebníci ohradili vůči tomu, aby firmy provozující umělé inteligence mohly trénovat na jejich licencované hudbě.

Anthropic v příspěvku na svém blogu označil a pojmenoval i konkrétní společnosti, které pravidla údajně porušily. Jsou to DeepSeek, Moonshot a MiniMax, přičemž největší vinu podle americké firmy měla poslední jmenovaná, která sídlí v Šanghaji a provozuje aplikaci Talkie.

Ta zaplavila chatbot Claude od Anthropicu více než třinácti miliony dotazy a výměnami dat. To výrazně přesahuje 3,4 milionu výměn u pekingské společnosti Moonshot s její AI Kimi a 150 tisíc u nejznámější čínské AI platformy DeepSeek.

Jak podvod funguje

Anthropic má svoje služby pro Čínu z důvodů národní bezpečnosti zablokované, takže by se tamní firmy k jeho službám neměly teoreticky ani dostat. Aby to obešly, využily podle Anthropicu komerční služby, které po celém světě prodávají přístup ke Claudovi a dalším špičkovým modelům umělé inteligence.

Tyto služby využívají takzvané „hydra cluster“ architektury: rozsáhlé sítě podvodných účtů, které distribuují provoz přes platformy třetích stran. „Rozsah těchto sítí znamená, že když je jeden účet zablokován, nahradí ho nový. V jednom případě spravovala jedna síť současně více než dvacet tisíc podvodných účtů a kombinovala provoz destilace s běžnými požadavky zákazníků, aby tak ztížila odhalení,“ popisuje Anthropic.

Jakmile se podařilo takto získat přístup, začaly čínské firmy vytvářet nastíněné obří objemy pečlivě vytvořených výzev, jejichž cílem bylo získat z amerického modelu specifické schopnosti. „Cílem je buď shromáždit vysoce kvalitní odpovědi pro přímý trénink modelu, nebo generovat desítky tisíc jedinečných úkolů potřebných pro spuštění posilového učení,“ popisuje americká forma formu útoku.

Čínské snahy o americká data

O podobné situaci informovala také další americká společnost OpenAI, která provozuje model ChatGPT. Na začátku února informovala americkou Sněmovnu reprezentantů v memorandu, v němž obvinila společnost DeepSeek z „pokračujících snah o bezplatné využívání schopností vyvinutých společností OpenAI a dalšími americkými laboratořemi“.

Toto zápolení probíhá v kontextu dynamických změn v úspěšnosti různých modelů umělých inteligencí. Právě čínský DeepSeek, který loni zaskočil svět svou kvalitou, by měl každým dnem uvést na trh svůj nejnovější vlajkový model DeepSeek V4.